I denne uge

Velkommen til denne uges udgave af Synapsen. Der er fart på udviklingen, både fra nye modeller til spændende funktioner i ChatGPT. Her er, hvad du kan læse om i dag:

Google har udgivet Gemini Pro 2.5, og den topper benchmarks

DeepSeek V3 er opdateret og forbedret på flere punkter

ChatGPT har opgraderet deres billede muligheder

OpenAI vil nu understøtte MCP standarden

Google Gemini Pro 2.5 Experimental

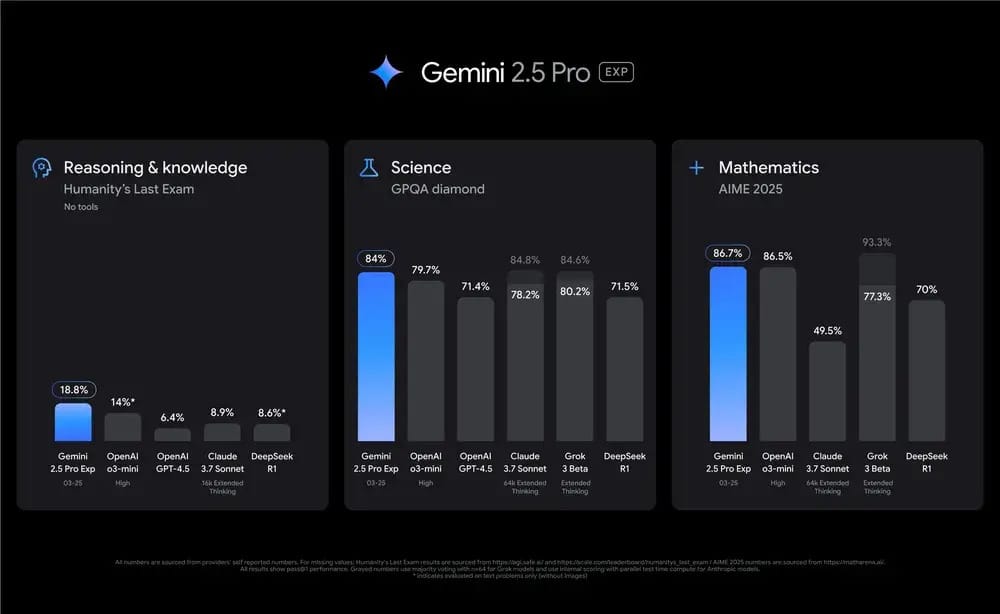

Vi starter med Google. De har frigivet Gemini Pro 2.5 Experimental i deres AI Studio, og den ser ud til at føre benchmarks på mange punkter. Modellen sprang på førstepladsen på lmarena, og ligger nr. 1 i alle kategorierne. Den opnår også en top score på 18,8% på Humanity's Last Exam (som er en benchmark på ekspert-niveau).

Den har et kontekstvindue på 1 million tokens (det vil sige, hvor meget tekst modellen kan holde styr på ad gangen), og Google lover at det snart bliver 2 millioner. Indtil videre er den gratis at bruge. Så bliver det spændende at se, om OpenAI snart har et modsvar klar.

DeepSeek V3

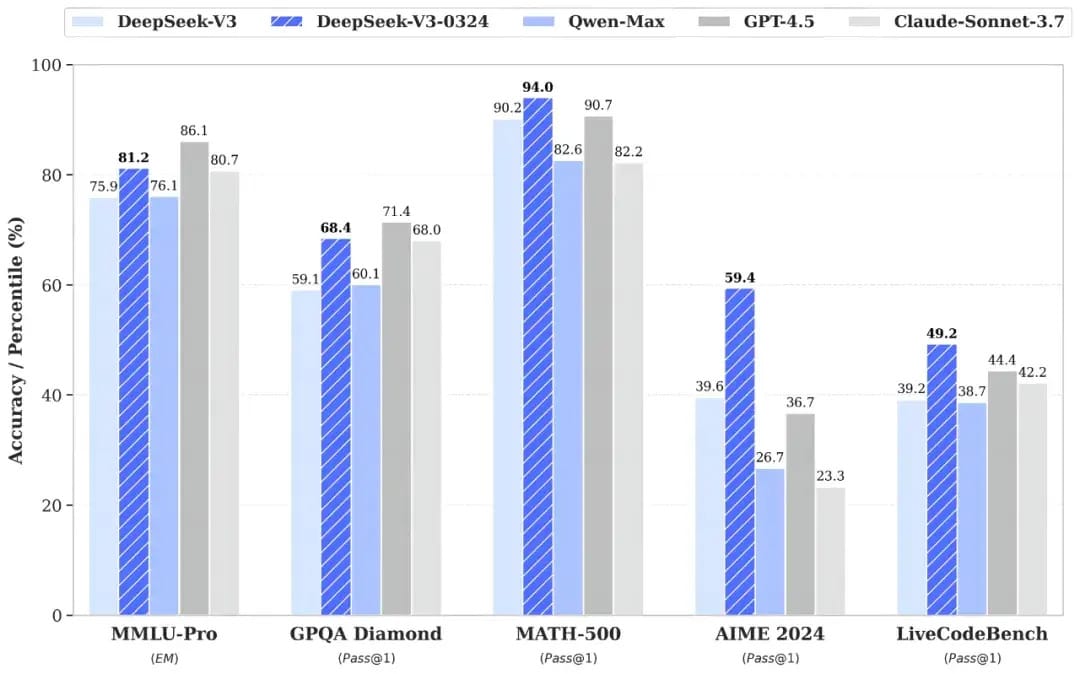

DeepSeek har heller ikke ligget på den lade side. Snart er DeepSeek R2 på vej (inden maj), men de har for nyligt i stilhed opdateret DeepSeek V3, så den nu klarer blandt andet kodning endnu bedre end tidligere. Og så er den jo open source med MIT licens. DeepSeek skriver selv, at det er en forbedring indenfor ræsonneringsevner og frontend-udvikling, samt at den har fået smartere værktøjsbrugsevner.

Kontekstvinduet er 128k, og prisen er 0,27 USD pr. million tokens (input) og 1,1 USD pr. million tokens (output). Til sammenligning koster GPT-4o hhv. 2,5 USD (input) og 10 USD (output).

ChatGPT opdatering

OpenAI’s ChatGPT har fået en overhaling på billedesiden. Nu kan GPT-4o selv generere billeder og behøver derfor ikke bruge DALL-E, som ellers har været standard. Det fungerer meget bedre end tidligere, især hvad angår tekst i billedet, som det kan ses i eksemplet.

Indtil videre er det kun tilgængeligt for betalende brugere hos OpenAI. Som alternativ kan Gemini Flash 2.0 Experimental benyttes gratis i AI Studio, og ellers kan man prøve den nye Reve Image 1.0.

OpenAI’s GPT-4o eksempel

OpenAI vil nu understøtte MCP standarden

Sam Altman fra OpenAI siger på X, at de vil understøtte MCP standarden (som Anthropic udviklede og som blandt andet bruges i Claude). I første omgang er det gennem deres Agents SDK, men senere kommer det også til deres desktop app og via API.

MCP står for Model Context Protocol, og er en universel protokol for tovejskommunikation mellem AI-systemer og eksterne værktøjer som f.eks. databaser, filsystemer mv. Kort sagt betyder det at en AI model kan tale sammen med (og gøre brug af) forskellige apps og værktøjer. F.eks. vil en AI kunne se fejl direkte i din browser’s konsol, og dermed gøre det nemmere at rette fejl automatisk.